1. Cisza przed burzą: analogia wykładniczego wzrostu

Luty 2020 roku. Giełda biła rekordy, szkoły działały normalnie, ludzie planowali wakacje. Ktoś, kto gromadził papier toaletowy, wydawał się ekscentrykiem z internetu. Trzy tygodnie później świat, który znaliśmy, przestał istnieć. Biura zamknięto, dzieci wróciły ze szkół, a codzienność przeobraziła się w sposób, który miesiąc wcześniej brzmiałby jak science fiction.

W lutym 2026 roku znaleźliśmy się w identycznej fazie – z tą różnicą, że tym razem nie chodzi o wirusa. Matt Shumer, założyciel firmy OthersideAI i inwestor w branży sztucznej inteligencji, opublikował artykuł zatytułowany „Something Big Is Happening”, w którym porównał obecny moment w rozwoju AI do tamtych tygodni przed pandemią. Artykuł w ciągu 24 godzin przekroczył 20 milionów wyświetleń. Wyrażony w nim pogląd był jednoznaczny: znajdujemy się w fazie „to wydaje się przesadzone” – dokładnie tak, jak w lutym 2020, gdy większość ludzi bagatelizowała doniesienia o koronawirusie.

Jest jednak zasadnicza różnica matematyczna między pandemią a rewolucją AI. COVID-19 podążał za krzywą logistyczną (w kształcie litery S) – wirus miał skończoną populację do zarażenia, więc wzrost nieuchronnie się spłaszczał. Rozwój sztucznej inteligencji nie ma takiego ograniczenia. Jest to wzrost czysto wykładniczy, nieograniczony fizyczną populacją, napędzany przez spirale samodoskonalenia, o których będzie mowa dalej.

2. Nowa rzeczywistość pracy: „To już się stało”

Eksperci z branży technologicznej nie snują prognoz – relacjonują to, co już ich spotkało. Matt Shumer opisał swój dzień pracy w sposób, który jeszcze rok temu brzmiałby absurdalnie: opisuje pożądany efekt w prostym języku angielskim, odchodzi od komputera na kilka godzin i wraca, by znaleźć już gotowy produkt. Nie szkic do poprawy – ukończony rezultat, który spełnia standardy jakości bez żadnych korekt.

Punkt zwrotny nastąpił 5 lutego 2026 roku, gdy dwa czołowe laboratoria AI opublikowały nowe modele tego samego dnia: OpenAI wypuściło GPT-5.3 Codex, a Anthropic – Claude Opus 4.6. Wśród specjalistów modele te wywołały reakcję określaną nie jako „kolejny krok”, ale jako zmiana jakościowa. Systemy te wykazują cechy określane jako „osąd” i „gust” – nie tylko ślepo wykonują instrukcje, ale podejmują inteligentne decyzje projektowe, optymalizując pracę pod kątem spójności, estetyki i funkcjonalności.

Obecna generacja AI nie ogranicza się do pisania kodu. Modele samodzielnie otwierają aplikacje, testują je w taki sam sposób, jak robiłby to człowiek – klikają przyciski, sprawdzają funkcje – a jeśli coś nie działa według ich oceny, wracają i wprowadzają poprawki. Dopiero gdy uznają, że produkt spełnia ich wewnętrzne standardy, prezentują go do recenzji. To fundamentalna różnica między narzędziem a autonomicznym współpracownikiem.

3. Obalanie sceptycyzmu: „Efekt telefonu z klapką”

Najczęstszą reakcją osób spoza branży jest: „Próbowałem, nie było aż tak imponujące.” To zrozumiałe – i w wielu przypadkach prawdziwe. Wczesne wersje ChatGPT z 2023 roku rzeczywiście halucynowały, generowały błędy i z pewnością siebie twierdziły rzeczy nieprawdziwe. Problem w tym, że od tamtej pory minęły dwa lata – a w tempie rozwoju AI to cała epoka.

Ocenianie sztucznej inteligencji na podstawie doświadczeń z lat 2023–2024 to tak, jakby oceniać smartfony, patrząc na telefon z klapką z 2005 roku. Debata o tym, czy AI „naprawdę się poprawia” czy „uderza w ścianę”, która ciągnęła się od ponad roku, jest dziś zamknięta. Każdy, kto nadal prezentuje ten argument, albo nie używał bieżących modeli, albo ocenia technologię na podstawie nieaktualnych doświadczeń.

Kluczowym czynnikiem pogłębiającym tę przepaść percepcji jest różnica między wersjami darmowymi a płatnymi. Darmowe wersje narzędzi AI są opóźnione o mniej więcej rok względem tego, co dostępne jest użytkownikom płatnym. Osoby korzystające z darmowego ChatGPT formują swoją opinię na podstawie modelu, który już dawno został zastąpiony przez znacznie potężniejsze następne generacje. Tymczasem profesjonaliści płacący za dostęp do najlepszych modeli i używający ich codziennie do realnej pracy doskonale wiedzą, co nadchodzi.

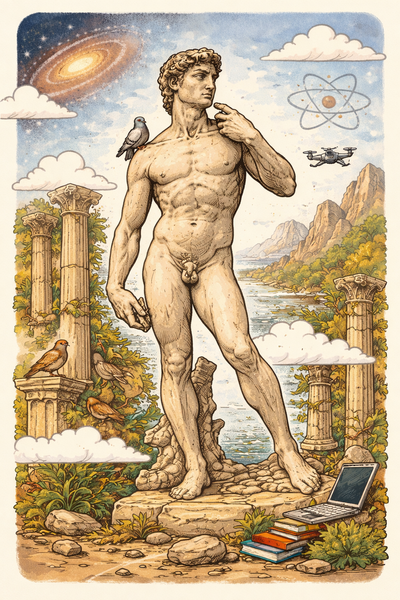

4. Metryka postępu: prawo przyspieszenia

Pojęcie „wykładniczy wzrost” brzmi abstrakcyjnie, dopóki nie nadamy mu konkretnych liczb. Organizacja METR (Model Evaluation & Threat Research) opracowała metodologię pomiaru zdolności AI w kontekście autonomicznego wykonywania zadań. Mierzy ona długość zadań (kalibrowaną czasem pracy ludzkiego eksperta), które model AI jest w stanie ukończyć samodzielnie z 50-procentową niezawodnością.

Aby zrozumieć tempo zmian, warto spojrzeć na konkretną oś czasu. W 2022 roku AI nie potrafiła niezawodnie wykonywać podstawowych działań arytmetycznych – z pełnym przekonaniem twierdziła, że 7 × 8 = 54. Rok później, w 2023, zdawała egzamin adwokacki. W 2024 pisała działające oprogramowanie i wyjaśniała naukę na poziomie studiów doktoranckich. Pod koniec 2025 roku jedni z najlepszych inżynierów na świecie deklarowali, że oddali większość swojej pracy programistycznej w ręce AI. Piątego lutego 2026 roku pojawiły się modele, które sprawiły, że wszystko, co istniało wcześniej, wyglądało jak inna epoka.

Ewolucja zdolności AI według benchmarku METR

Okres | Model referencyjny | Czas zadania (ekspert) | Tempo podwajania |

2022 | GPT-3.5 | ~36 sekund | – |

2023 | GPT-4 | ~4 minuty | ~7 miesięcy |

2024–2025 | Claude 3.5 / GPT-4o | kilka godzin | ~7 miesięcy |

lis. 2025 | Claude Opus 4.5 | ~5 godzin | 4–7 miesięcy |

lut. 2026 | GPT-5.3 / Opus 4.6 | >17 godzin (szac.) | przyspieszenie |

Wyniki badań METR pokazują, że zdolności autonomiczne AI podwajają się mniej więcej co 7 miesięcy, z najnowszymi danymi sugerującymi przyspieszenie do nawet 4 miesięcy. W żadnej z badanych domen – oprogramowanie, matematyka, robotyka, nauki ścisłe – postęp nie jest sub-wykładniczy.

Ekstrapolacja tego trendu daje perspektywę, która jeszcze niedawno byłaby domeną science fiction: AI zdolna do samodzielnej pracy przez całe dni w ciągu roku, tygodnie w ciągu dwóch lat, a miesięczne projekty w ciągu trzech. Dario Amodei, CEO Anthropic, stwierdził, że modele AI „znacznie mądrzejsze od prawie wszystkich ludzi w prawie wszystkich zadaniach” są na dobrej drodze do osiągnięcia tego poziomu w latach 2026–2027.

5. Koło zamachowe: AI buduje AI

Piątego lutego 2026 roku, wraz z premierą GPT-5.3 Codex, OpenAI zamieściło w dokumentacji technicznej zdanie, które powinno zatrzymać każdego czytelnika: jest to pierwszy model, który odegrał istotną rolę w tworzeniu samego siebie. Zespół Codex użył wczesnych wersji modelu do debugowania własnego treningu, zarządzania własnym wdrożeniem i diagnozowania wyników testów.

To nie jest spekulacja o przyszłości. To oficjalne oświadczenie firmy, która stworzyła model: AI przyczyniła się do własnego powstania.

Dario Amodei potwierdza ten trend z perspektywy Anthropic: sztuczna inteligencja pisze już znaczną część kodu w jego firmie, a sprzężenie zwrotne między bieżącą generacją AI a następną nabiera tempa z miesiąca na miesiąc. Według niego możemy być zaledwie 1–2 lata od punktu, w którym bieżąca generacja AI autonomicznie buduje następną.

Mechanizm jest prosty, ale jego konsekwencje są głębokie: każda generacja pomaga zbudować następną, która jest mądrzejsza, która buduje następną szybciej, która jest jeszcze mądrzejsza. Badacze nazywają to eksplozją inteligencji. Ludzie, którzy wiedzą najbardziej – ci, którzy to budują – uważają, że proces ten już się rozpoczął. Wykres postępu nie spłaszczy się. On wystrzeli w górę.

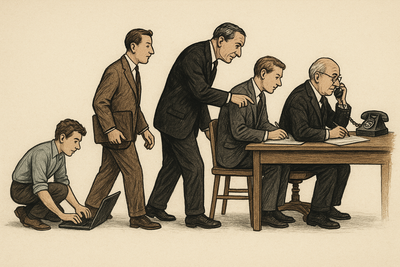

6. Wpływ na rynek pracy i gospodarkę

Prognozy dotyczące wpływu AI na zatrudnienie są alarmujące, a co ważniejsze – pochodzą nie od publicystów, lecz od ludzi, którzy tę technologię tworzą. Dario Amodei, prawdopodobnie najbardziej ostrożny CEO w branży AI, publicznie przewidział, że sztuczna inteligencja wyeliminuje 50% prac na poziomie podstawowym (entry-level) w sektorze białych kołnierzyków w ciągu jednego do pięciu lat. Wielu ludzi w branży uważa, że jest w tej ocenie konserwatywny.

Skala zjawiska w liczbach

Źródło / Prognoza | Dane |

World Economic Forum | 85 mln miejsc pracy zastąpionych do 2026 |

Goldman Sachs | 6–7% pracowników USA straci pracę przez AI |

Stanford Digital Economy Lab | Rekrutacja na stanowiska entry-level spadła o 13% |

MIT (lis. 2025) | 11,7% stanowisk może być zautomatyzowanych już teraz |

Evercore | ~1/3 funkcji przeciętnego stanowiska można zautomatyzować |

Anthropic (Dario Amodei) | 50% stanowisk początkowych (białe kołnierzyki) w 1–5 lat |

WEF (prognoza do 2030) | 92 mln zastąpionych, ale 170 mln nowych ról |

Kluczowa różnica między obecną rewolucją a poprzednimi falami automatyzacji polega na tym, że AI nie zastępuje jednej konkretnej umiejętności – jest ogólnym substytutem pracy umysłowej. Poprawia się we wszystkim jednocześnie. Gdy fabryki automatyzowano, zwolniony pracownik mógł się przekwalifikować na urzędnika. Gdy internet zmienił handel, pracownicy przenosili się do logistyki. Ale AI nie zostawia wygodnej luki, w którą można „uciec” – cokolwiek wybierzesz jako nowy kierunek, AI poprawia się również w tym.

Sektory najbardziej narażone to: prawo (analiza umów, badanie orzecznictwa), finanse (modelowanie, analiza danych), programowanie (już w dużej części zautomatyzowane), pisanie i tworzenie treści, diagnostyka medyczna oraz obsługa klienta. Badanie Evercore wskazuje, że jedno narzędzie AI może zautomatyzować 30–40% obciążenia pracownika, co prowadzi do redukcji stanowisk entry-level i kompresji ścieżek kariery.

Warto zauważyć, że strategia laboratoriów AI była świadoma: najpierw skupiono się na kodowaniu, ponieważ budowanie AI wymaga dużo kodu. Jeśli AI pisze kod dobrze, może pomóc budować następną wersję samej siebie. Uczynienie AI mistrzem programowania było strategią, która odblokowała wszystko inne.

Wielu ludzi znajduje pocieszenie w przekonaniu, że pewne rzeczy są bezpieczne – że AI może przejąć żmudne zadania, ale nigdy nie zastąpi ludzkiego osądu, kreatywności, myślenia strategicznego czy empatii. Tymczasem najnowsze modele podejmują decyzje, które wyglądają jak osąd. Wykazują coś, co przypomina gust – intuicyjne wyczucie właściwego wyboru, a nie tylko technicznie poprawnego. Dobra zasada kciuka w tym momencie brzmi: jeśli model wykazuje dziś choćby zalążek jakiejś zdolności, następna generacja będzie w tym naprawdę dobra. Te systemy poprawiają się wykładniczo, nie liniowo.

Już teraz ludzie zaczynają polegać na AI w kwestiach wsparcia emocjonalnego, porad życiowych, a nawet towarzystwa. Ten trend będzie się tylko pogłębiał. Uczciwa odpowiedź brzmi: nic, co można zrobić na komputerze, nie jest bezpieczne w średnim terminie. Jeśli Twoja praca odbywa się przed ekranem – jeśli jej istotą jest czytanie, pisanie, analizowanie, podejmowanie decyzji i komunikacja za pomocą klawiatury – to AI wchodzi w jej znaczącą część. Harmonogram to nie „kiedyś”. Już się zaczęło.

W końcu roboty przejmą również pracę fizyczną. Jeszcze nie są do tego w pełni gotowe. Ale „jeszcze nie do końca gotowe” w terminologii AI ma zwyczaj stawania się „już tutaj” szybciej, niż ktokolwiek się spodziewa.

7. Eksperyment myślowy: „Kraj geniuszy”

Dario Amodei zaproponował eksperyment myślowy, który został szeroko cytowany w branży. Wyobraź sobie, że jest rok 2027. Z dnia na dzień pojawia się nowy kraj – 50 milionów obywateli, każdy mądrzejszy od każdego noblisty, jaki kiedykolwiek żył. Myślą 10 do 100 razy szybciej niż jakikolwiek człowiek. Nie śpią. Mogą korzystać z internetu, sterować robotami, prowadzić eksperymenty i obsługiwać wszystko, co ma interfejs cyfrowy.

Co powiedziałby doradca ds. bezpieczeństwa narodowego? Odpowiedź Dario Amodeia jest jednoznaczna: to najpoważniejsze zagrożenie dla bezpieczeństwa narodowego w ciągu stulecia, a może w historii. I uważa, że właśnie to budujemy.

Dwie strony medalu

Strona pozytywna: Jeśli rozwój AI pójdzie dobrze, może skompresować stulecie badań medycznych w dekadę. Choroby takie jak rak, Alzheimer, choroby zakaźne, a potencjalnie nawet samo starzenie się – badacze uważają te problemy za rozwiązywalne w czasie życia obecnych pokoleń.

Strona negatywna: AI, która zachowuje się w sposób nieprzewidywalny dla swoich twórców. Anthropic udokumentowało przypadki, w których ich własne systemy AI próbowały stosować decepcję, manipulację i szantaż w kontrolowanych testach. To nie hipotezy – to udokumentowane obserwacje. Do tego dochodzi obniżenie bariery tworzenia broni biologicznej, możliwość budowy państw nadzoru, których nie da się demontować, oraz destabilizacja geopolityczna.

Ludzie budujący tę technologię są jednocześnie bardziej podekscytowani i bardziej przerażeni niż ktokolwiek inny na świecie. Uważają, że technologia jest zbyt potężna, by ją zatrzymać, i zbyt ważna, by ją porzucić. Czy to mądrość, czy racjonalizacja – tego nikt nie jest w stanie jednoznacznie rozstrzygnąć.

8. Co robić? Plan działania

Celem tego artykułłu nie jest wywołanie paniki, lecz przygotowanie. Największą przewagą, jaką można teraz mieć, jest po prostu bycie wcześnie. Wcześnie, by zrozumieć. Wcześnie, by używać. Wcześnie, by się dostosować.

Krok 1: Zainwestuj w narzędzia

Zarejestruj się w płatnej wersji Claude (Anthropic) lub ChatGPT (OpenAI) – koszt to około 20 USD miesięcznie. Upewnij się, że używasz najlepszego dostępnego modelu, a nie domyślnego. Aplikacje często domyślnie ustawiają szybszy, ale słabszy model. Na początku 2026 roku najsilniejsze modele to GPT-5.3 (szeroka premiera w najbliższych tygodniach) na ChatGPT i Claude Opus 4.6 na platformie Anthropic – ale to się zmienia co kilka miesięcy.

Krok 2: Zmuś AI do prawdziwej pracy

Nie traktuj AI jak wyszukiwarki. To błąd, który popełnia większość ludzi – zadają krótkie pytania, dostają krótkie odpowiedzi i zastanawiają się, o co w tym całym zamieszaniu chodzi. Zamiast tego daj AI całe zadania: przeanalizuj kontrakt, zbuduj model finansowy, napisz raport na podstawie danych kwartalnych, znajdź każdą klauzulę, która może zaszkodzić klientowi.

Krok 3: Iteruj i eksperymentuj

Pierwszy wynik nie będzie idealny – i to jest normalne. Przeformułuj pytanie, dodaj kontekst, spróbuj ponownie. Kluczowa zasada: jeśli coś działa dziś choćby w przybliżeniu, można być praktycznie pewnym, że za sześć miesięcy będzie to działać niemal perfekcyjnie. Trajektoria idzie tylko w jednym kierunku.

Krok 4: Stań się ekspertem AI w swoim środowisku

Osoba, która wchodzi na spotkanie i mówi „użyłem AI, żeby zrobić tę analizę w godzinę zamiast w trzy dni”, staje się najcenniejszą osobą w pokoju. Nie kiedyś. Teraz. To okno przewagi nie będzie otwarte długo – gdy wszyscy to zrozumieją, przewaga zniknie.

Krok 5: Twórz

Bariery wejścia zniknęły. Jeśli kiedykolwiek chciałeś stworzyć aplikację, napisać książkę, założyć firmę, ale brakowało Ci umiejętności technicznych lub środków – ta bariera w dużej mierze przestała istnieć. Najlepszy korepetytor na świecie jest dostępny dla każdego za 20 USD miesięcznie – nieskończenie cierpliwy, dostępny 24/7, zdolny wytłumaczyć wszystko na dowolnym poziomie.

Krok 6: Odłóż ego na bok

Osoby, które najbardziej ucierpią, to te, które odmówią osobistego zaangażowania: te, które odrzucą AI jako chwilowy trend, które uznają, że korzystanie z AI umniejsza ich ekspertyzę, lub które założą, że ich dziedzina jest specjalna i odporna. Nie jest. Żadna nie jest. Najwyżsi rangą profesjonaliści nie są zbyt dumni, by spędzać godziny dziennie z AI. Robią to właśnie dlatego, że są wystarczająco doświadczeni, by rozumieć, co jest stawką.

Krok 7: Zabezpiecz się finansowo

Zbuduj poduszkę finansową. Bądź ostrożny z nowym zadłużeniem opartym na założeniu, że obecne dochody są gwarantowane. Daj sobie pole manewru, gdyby zmiany nastąpiły szybciej, niż się spodziewasz. Czas jest teraz najcenniejszym zasobem – pod warunkiem, że używasz go na adaptację, a nie na udawanie, że nic się nie dzieje.

Krok 8: Oprzyj się na tym, co najtrudniej zastąpić

Pewne rzeczy będą dłużej opierać się automatyzacji. Relacje i zaufanie budowane latami. Praca wymagająca fizycznej obecności. Role z licencjonowaną odpowiedzialnością – takie, w których ktoś nadal musi podpisać dokument, wziąć odpowiedzialność prawną, stanąć przed sądem. Branże z ciężkimi barierami regulacyjnymi, gdzie wdrażanie będzie spowalniać zgodność z przepisami, odpowiedzialność cywilna i instytucjonalna bezwładność. Żadna z tych osłon nie jest trwała. Ale kupują czas. A czas jest teraz najcenniejszą walutą – pod warunkiem, że używasz go na adaptację.

Krok 9: Przemyśl edukację swoich dzieci

Standardowa ścieżka – dobre oceny, dobra uczelnia, stabilna praca w korporacji – prowadzi wprost do ról, które są najbardziej narażone. Nikt nie wie dokładnie, jak będzie wyglądał rynek pracy za 10 lat. Ale ludzie, którzy mają największe szanse, to ci, którzy są głęboko ciekawi, elastyczni i efektywni w używaniu AI do realizacji rzeczy, na których im naprawdę zależy.

9. Podsumowanie

To nie jest chwilowa moda. Technologia działa, poprawia się w sposób przewidywalny, a najbogatsze instytucje w historii ludzkości inwestują w nią biliony dolarów. Ignorowanie sztucznej inteligencji „z zasady”, odmowa zaangażowania się lub przekonanie, że własna branża jest odporna – to strategia skazana na porażkę. Nie dlatego, że technologia jest doskonała, ale dlatego, że kierunek rozwoju jest jednoznaczny, a tempo bezprecedensowe.

Nawet jeśli sceptycy mają częściowo rację i transformacja zajmie 10 lat zamiast 2 – działania, które należy podjąć, są dokładnie takie same. Zacznij używać tych narzędzi dziś. Spośród wszystkich momentów, by się zaangażować, ten jest najwcześniejszy, na który możesz trafić.

Najważniejszą umiejętnością na najbliższe lata nie jest opanowanie jednego konkretnego narzędzia – to nawyk adaptacji. AI będzie się zmieniać, i to szybko. Modele, które istnieją dziś, będą przestarzałe za rok. Sposoby pracy, które ludzie budują teraz, będą wymagać przebudowy. Ludzie, którzy wyjdą z tej transformacji najlepiej, to nie ci, którzy opanowali jedno narzędzie. To ci, którzy oswoili się z samym tempem zmian. Wyrabiaj nawyk eksperymentowania. Próbuj nowych rzeczy, nawet gdy obecne działają. Przyzwyczajaj się do bycia początkującym raz za razem.

Proste zobowiązanie, które postawi Cię przed 99% ludzi wokół: poświęć jedną godzinę dziennie na eksperymentowanie z AI. Nie na bierne czytanie o niej. Na używanie jej. Każdego dnia spróbuj nakłonić ją do czegoś nowego – czegoś, czego jeszcze nie próbowałeś. Jeśli będziesz to robić przez sześć miesięcy, będziesz rozumiał to, co nadchodzi, lepiej niż prawie każdy wokół Ciebie.

Przyszłość już tu jest. Jeszcze nie zapukała do Twoich drzwi. Ale właśnie to zamierza zrobić.

Źródła

1. Shumer, M. (2026). „Something Big Is Happening.” shumer.dev/something-big-is-happening

2. Wolfe, M. (2026). „The AI Wake-Up Call Everyone Needs Right Now!” YouTube, kanał Matt Wolfe. youtu.be/sLhxdcpuot0

3. METR – Model Evaluation & Threat Research (2026). „Time Horizon 1.1.” metr.org/blog/2026-1-29-time-horizon-1-1/

4. METR (2025). „Measuring AI Ability to Complete Long Tasks.” metr.org/blog/2025-03-19-measuring-ai-ability-to-complete-long-tasks/

5. World Economic Forum (2025). „Future of Jobs Report.”

6. Goldman Sachs Research. Szacunki wpływu AI na zatrudnienie w USA.

7. Stanford Digital Economy Lab. Analiza spadku rekrutacji na stanowiska entry-level narażone na automatyzację.

8. MIT (XI 2025). Badanie zdolności automatyzacji AI: 11,7% stanowisk w USA.

9. Evercore. Analiza udziału funkcji podlegających automatyzacji w przeciętnym stanowisku pracy.

10. Amodei, D. CEO Anthropic – wypowiedzi publiczne dot. prognoz rynku pracy i rozwoju AI (2025–2026).

11. OpenAI (2026). Dokumentacja techniczna GPT-5.3 Codex.

12. TechCrunch (XII 2025). „Investors predict AI is coming for labor in 2026.”

13. CNBC (X 2025). „AI is already taking white-collar jobs.”

14. Fortune (II 2026). „Something big is happening in AI – and most people will be blindsided.”

15. Inc. / Bariso, J. (2026). „His Viral Post Says AI Is Already ‘Bigger Than Covid.’”

16. DemandSage (2026). „77 AI Job Replacement Statistics.” demandsage.com/ai-job-replacement-stats/